- 大家好,我是FinTech社区创始人Lucy。 FinTech社区主要从事金融科技/量化投资/区块链招聘的社区

- 目前我们与电鸭合作,有大量区块链相关职位的招聘,有兴趣的可以关注我们的招聘帖子:https://eleduck.com/posts/pqfJRb

有招聘需求的企业也能够通过邮箱 dianya@fintechgl.com 联系我们哟!

技术类问题

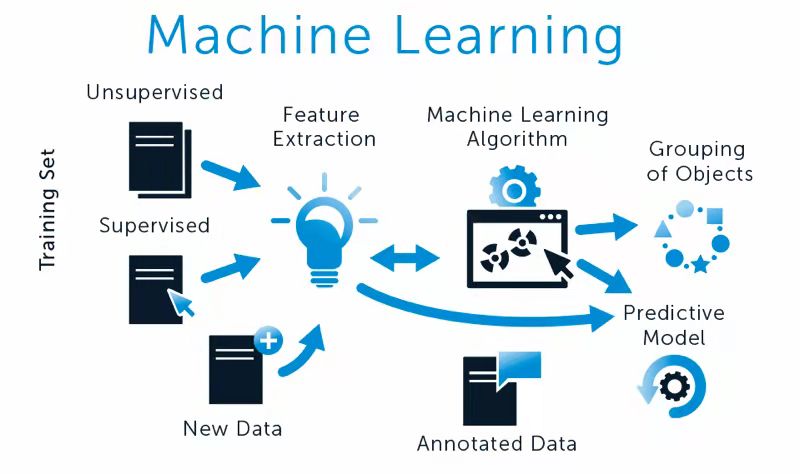

Q: 说说你是怎样理解机器学习的?

A: 机器学习是人工智能的一种应用,它能让系统具有自主学习的能力,无需额外编程即可从过去的经验中不断完善。机器学习的重点放在开发能够获取数据,并从数据中自主学习的计算机程序。

Q: 什么不能被归为机器学习?

**A:**基于规则的推理及人工智能。

Q: 举一个具体的例子,解释机器学习在工业中是怎样应用的。

A: 最典型的应用是机器人自动化。机器人通过从传感器搜集来的数据,利用机器人编程软件,从数据中进行学习,以便更智能的进行操作,完成工作。

Q: 机器学习领域中的算法大类有哪些?

A: 强化学习(reinforcement learning);监督学习(supervised learning);非监督学习(unsupervised learning);半监督学习(semi-supervised learning);直推学习(transductive learning);元学习(meta learning/ learning to learn)。

Q: 一句话描述监督学习与非监督学习的区别?

A: 监督学习有目标变量的分类信息,知道自己要预测什么,或者数据有类别信息。

Q: 非监督学习的作用有哪些?

A: 聚类;寻找数据的低维度表征;趋势分析;关联分析;新观察结果发掘。

Q: 监督学习的作用有哪些?

A: 分类;语义识别;回归;预测时间序列;字符串注释。

Q: 朴素贝叶斯的好处和不足有哪些?

A: 好处— 1)该分类器比其他判别模型收敛更快;2)在数据缺少的情况下仍然有效,可处理多类别问题。

不足— 1)不适用于数值型数据;2)分类结果依赖于对数据分布形状所作的前提假设。

Q: 朴素贝叶斯朴素在哪里?

A:“朴素”在于整个形式化过程只做最原始、最简单的假设,即数据集中所有特征同等重要,且相互独立。

Q: 怎样判断机器学习出现了过拟合?

A: 当统计学模型不再描述隐藏关系,而是白噪声或者随机误差时;或者该统计学模型已过于复杂。

Q: 什么情况下可能会发生过拟合?以及如何避免?

A: 当算法训练和模型测试的标准不统一时会发生过拟合。可以通过1)使用大量数据;2)交叉验证避免。

Q: 当下,机器学习中最常用的5种算法是什么?

A: 1)决策树;2)概率网络;3)近邻法;4)支持向量(SVM);5)神经网络。

Q: 列举一些机器学习的应用案例?

A: 1)反欺诈;2)人脸识别;3)自然语言处理;4)市场细分;5)文本分类;6)生物信息学。

Q: 解释一下参数模型和非参数模型?

A: 属于数理统计学中的概念,参数模型和非参数模型中的“参数”并不是模型中的参数,而是数据分布的参数。参数模型通常假设总体服从某个分布,这个分布可以由一些参数确定,因此只需知道构建模型的参数,根据指定的目标函数的形式,即可预测新数据;非参数模型对于总体的分布不做任何假设或者说是数据分布假设自由,只知道其分布是存在的,所以就无法得到其分布的相关参数,只能通过非参数统计的方法进行推断,具有更大的灵活度。

Q: 机器学习建模的三步骤是什么?

A: 1)建立模型;2)运用模型;3)测试模型。

Q: 什么是归纳逻辑编程(ILP: inductive logic programming)?

A: ILP是机器学习的一个分支,以一阶逻辑归纳理论为基础,并以一阶逻辑为表达语言的符号规则学习方法。ILP学得的模型是易于理解的一阶逻辑符号规则,而非黑箱模型;在学习中可以相对容易地显式利用以一阶逻辑描述的领域知识;学得模型能对领域中个体间的关系进行建模,而非仅仅对个体的标记进行预测。

Q: 分类和回归的区别?

A: 分类是将实例数据划分到合适的类别中;回归主要用来预测数值型数据。

Q: 归纳和演绎机器学习的区别是什么?

A: 归纳是从“具体到一般”的过程,是从一系列实例中进行总结学习推导出规律和结论的学习方法;演绎是从“一般到特殊”的学习方法,先得出几个结论,再将结论具像化。

Q: 决策树的好处和不足分别有哪些?

A: 好处—计算复杂度不高,输出结果便于理解;对中间值的缺失不敏感;可以处理不相关特征数据。

不足—很容易产生过拟合现象,但可以使用集成学习算法(ensemble methods),如随即森林或提升树等避免。

Q: 神经网络的好处和不足分别有哪些?

A: 好处—对非结构化的数据集,如图片、音频、视频等的处理带来了革命性的变化。它史无前例的灵活性是其他机器学习算法所无可比拟的。

不足—需要大量的训练数据来收敛;不太容易获得正确的架构;内部“隐藏层”不便于理解。

Q: L1和L2正则化有哪些区别?

A: 正则化的本质是在损失函数cost function后加上p-范数,也称正则化项或模型复杂度惩罚项,用于减少过拟合程度。用L1正则化的模型就叫做Lasso回归,用L2正则化的模型叫做Ridge回归(岭回归):

-

L1减少的是一个常量,L2减少的是权重的固定比例;

-

L1使权重稀疏,L2使权重平滑;

-

L1优点是能够获得sparse模型,对于large-scale的问题来说这一点很重要,因为可以减少存储空间;

-

L2优点是实现简单,能够起到正则化的作用。缺点就是L1的优点:无法获得sparse模型。

Q: 描述一张哈希表?

A: 哈希表也叫散列表,据关键码值而直接进行访问的数据结构,通过把关键码值映射到表中一个位置来访问记录,以加快查找的速度。这个映射函数叫做哈希函数,存放记录的数组叫做哈希表或散列表。

Q: 什么是核机制(kernel trick)?为啥它这么有用?

A: Kernel的基本思想是,将低维空间不可分数据映射到高纬度的空间,增大其线性可分的概率。具体讲, kerne trick是定义一个核函数K(x1,x2) = <\phi(x1), \phi(x2)>, 其中x1和x2是低维度空间中点(在这里可以是标量,也可以是向量),\phi(xi)是低维度空间的点xi转化为高维度空间中的点的表示,< , > 表示向量的内积。

Q: 如何处理数据集中缺失或损坏数据?

A: 发现缺失/损坏数据,从行/列中将其去掉,或者用别的数据值代替。

贴心链接

【1】

40道关于机器学习的练习题

【2】

30道自然语言处理练习题

【3】

https://www.analyticsvidhya.com/blog/2017/09/30-questions-test-tree-based-models/

30道决策树练习题

【4】

https://www.analyticsvidhya.com/blog/2017/10/svm-skilltest/

25道支持向量机练习题

【5】

https://www.analyticsvidhya.com/blog/2017/03/questions-dimensionality-reduction-data-scientist/

40道维度缩减练习题

【6】

https://www.analyticsvidhya.com/blog/2017/02/test-data-scientist-clustering/

40道聚类练习题

技术类问题

Q: 你是否有机器学习领域的经验?

A: 这道题很主观,但同时又很重要。招聘者一般都喜欢有经验的求职者,不用做过多培训即可上岗。所以如果你有机器学习研究领域的经验,这可是个大大的加分项,确保面试的时候带上自己的研究成果和学习资料,以便让面试官更好得了解你的优势。

Q: 挑个算法,写段用于并行实现的伪代码

A: 这道题是用来考验面试者对“并行”这个概念的理解,及是否能并行思考,也能反映处理大数据并发的能力。一个小的tips:在做伪代码框架时,可以考虑用Peril-L和web diagram sequency来实现用于展现并行的伪代码可视化工具。

Q: 一般你都从哪儿寻找数据集?

A: 这也是面试者经常喜欢问的,用来测试求职者是否真心喜爱机器学习。一般对机器学习真心感兴趣的,会建立自己的小项目,也会对好的数据集出处了如指掌。这里可以提供两个:Quandl,提供不少关于经济和金融方面的数据集;Kaggle's dataset也不错。

Q: 讲几个你最喜欢的机器学习应用案例?

A: 这道题面试官也很喜欢问,用来测试求职者对机器学习的理解和兴趣。小建议:可以去Quora网站上多找找应用案例,准备一下。

Q: 模型精确度比较重要还是模型性能更重要?

A: 这道题没有标准情况,取决于应用案例。回答这道题的技巧取决于举例说明。如果你是用机器学习来分析医学疾病,那模型准确度要远远大于它算得快。这道题也是面试者的心头好,用来试水求职者的能力。

2

2